法安网内容检索

.jpg)

.jpg)

.jpg)

.jpg)

当前位置: 首页 > 产品方案 > 方案展示 > AI大模型 >

时间:2025-10-17 10:20:46 来源:武欣 北京互联网法院

[法安导读]【摘 要】:“法官画像”是对已公开裁判文书司法大数据中法官的裁判行为进行统计分析, 解读出具体法官在...

【摘 要】:“法官画像”是对已公开裁判文书司法大数据中法官的裁判行为进行统计分析, 解读出具体法官在处理相关法律问题时可能采取的行为模式,并公之于众。法官可能会受到人工智能工具裁判预测结果的影响;滥用法官画像,当事人可能会采取挑选法院或法官的诉讼投机行为。对此文章相应提出保障法官审判独立公正、细化人工智能在裁判预测中应用边界的规制路径。

【关键词】:法官画像 公开裁判文书 裁判预测 应用边界 规制路径

引言

哥伦比亚加西亚法官首次使用ChatGPT,在人工智能文本生成器辅助下做出法庭裁决。此案引发人工智能在司法审判中参与深度及使用边界的探讨。国内人工智能应用在类案尺度统一、诉讼风险评估等方面发挥积极作用,但同时也带来诸如滥用“法官画像”等违背司法裁判规则的风险。法院如何限定人工智能在裁判预测行为中的使用边界是值得研究的问题。

一、裁判预测与“法官画像”的界定

(一)裁判预测

是在原有充分审判信息基础上对未来的推断。大量公开的司法大数据为人工智能工具实现类案推送、偏离度预警、诉讼风险评估提供了数据来源,其通过抓取案件特征、对比关键词句、构建案件基本结构、大量学习语言等技术,预测类案的裁判结果。

(二)法官画像

是通过对已公开的裁判文书司法大数据中法官的裁判行为进行统计分析, 得出具体法官在处理相关法律问题时可能采取的行为模式,并公之于众。法官画像是将大数据中的识别分析应用到描述具体法官方面,将用以描述法官个人的工作效率、裁判尺度高低、是否偏好案件调解结案、个人审判风格、所在法院或行迹等,异化成为了对法官个人裁判的规律性的研究。

二、异化裁判预测的风险及隐患

异化裁判预测不加以规制,主要存在两方面的影响。一是法官在利用人工智能进行裁判预测时,可能会影响实体公正。

(一)类案预测可能会压缩法官在个案中的自由裁量权,以统一裁判代替公正裁判。

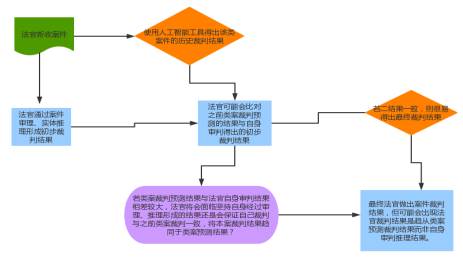

图1(法官审理案件受类案预测结果的影响过程)

司法审判一旦形成对人工智能工具预测的裁判结果形成依赖,就可能导致:司法裁判论述中论证理由依赖于已公开的先前裁判数据,最重要的论证过程也并非裁判结果得出的过程,而裁判结果只是对过去的模仿。

(二)人工智能对个案预测的结果可能会约束法官司法裁判的结果,以结果预测取代推理论证。

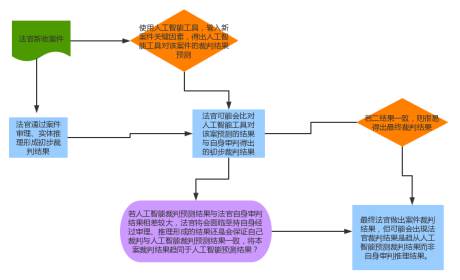

图2(法官审理案件受类案预测结果的影响过程)

通过人工智能工具进行个案预测得出的结论对法官进行个案裁判的影响程度需要我们警醒。例如法官新收一个同类型案件,出于疲于应对大量案件或想简单省事,参考甚至完全采用人工智能工具推算出的个案结果时,就是颠倒了“从理由到结论”司法裁判的顺序。

(三)滥用“法官画像”可能会促使当事人采取挑选法院或法官的诉讼投机行为。

当原告拥有较多的管辖链接点时,某些法院或者法官可能会利用更有益于原告的裁判结果,从而吸引更多案源。类似“兜售管辖权”,法院或法官在个案裁判中有意形成倾向原告的裁判结果,进而通过司法大数据的分析、统计,呈现这种倾向,法官逆向通过“法官画像”实现自身目的。具体诉讼个案的分配,目前多数法院原则上均采取“随机分配”与“平均分配”的原则。选择管辖法院或挑选裁判法官违背了该原则。

三、人工智能在裁判预测中的规制路径

(一)保障法官审判独立公正的规制路径

1.确立法官在个案中作为价值判断的主体

滥用“法官画像”,个别本应特殊化裁判、个别化量刑的个案,可能会被人工智能工具归为貌似相同的应该进行相同处理的类案。人工智能工具兼有保障廉洁司法,提高司法管理水平等功能,可能会对法官造成一种无形的监督压力。法官进行司法裁判时应避免过多地考虑案外因素,保证司法裁判者能够亲历性、封闭性地独立思考,行使司法裁判权。

2.限制人工智能工具在司法实践中的使用场景

除加西亚法官案例外,美国等国的判例中也已出现人工智能决策工具来确定量刑或刑事被告是否保释的作法。在国内,类似的人工智能工具有:上海刑事案件智能辅助办案系统(简称上海“206 系统”)的“量刑参考”功能。最高人民法院2018 年推出“类案智能推送系统”。河北省高级人民法院研发的具有文书自动生成功能的智审系统,能够减轻法官30%以上的案头事务性工作。随着人工智能工具在国内外司法实践中的广泛应用,法官主动适用人工智能工具的边界亟需规范。

人工智能分析模型新发现的信息不具可预知性,整个过程相当不透明”。人工智能工具的定位应该仅限于对审判工作的辅助性,人工智能辅助结果仅可作为审判工作或审判监督管理的参考,应当确保司法裁判始终由审判法官作出,裁判职权始终由审判组织行使,司法责任最终由裁判者承担。因为人工智能工具并不能使人类 “摆脱曲解、隔阂和错误的成见”。

(二)人工智能在裁判预测中应用边界的规制

法国立法者认为, 基于“法官画像”的大数据挖掘分析, 可能会给法官履职带来压力并影响司法活动的正常开展。我国最高人民法院虽然2022年出台《最高人民法院关于规范和加强人工智能司法应用的意见》,但该意见并未具体明确到人工智能通过司法大数据在裁判预测中的应用边界,以及该如何通过对人工智能技术产品的设计限制避免产生滥用“法官画像”的问题。建议可在该规定的基础上细化有关人工智能通过司法大数据在裁判预测中的应用边界,通过对人工智能技术产品的设计限制,避免出现滥用“法官画像”的现象。

同时应从司法大数据技术风险防控的算法“顶层设计”入手,即出台相关规定,禁止在人工智能工具建立数据分析模型伊始,将法官个人的身份信息输入其中,避免形成基于法官个人的裁判预测,规范司法大数据辅助审判应用的研发基本准则和底线。配合出台相关规定,确立司法大数据辅助审判应用研发的审核机制与问责机制,区别司法大数据应用的研发者和使用者责任;加强司法大数据辅助审判应用的可追溯性、可解释性和算法的公开,推进司法大数据应用技术透明度的提高,以增强司法大数据辅助审判的可信赖性。

责任编辑:广汉

声明:

本网站图片,文字之类版权申明,因为网站可以由注册用户自行上传图片或文字,本网站无法鉴别所上传图片或文字的知识版权,如果侵犯,请及时通知我们,本网站将在第一时间及时删除。

征稿启事

品牌推荐更多>>